Softmax分类器

Softmax 函数用于多分类,他将多个神经元的输出的值映射到(0,1)区间内的一个值,,并且映射的所有值相加为1,这些值可以理解为输出的概率,输出概率较大的一般作为预测的值

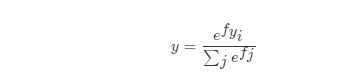

计算公式

分子:fyi 表示第i个类别指数值

分母求和fj 所有元素的指数和

softmax作用过程:假如对于神经元的输出值3,1,-3通过softmax函数,映射成为(0,1)之间范围的值,而这些值的累和为1,

P(3∣score)=e3/(e3+e1+e-3)=0.88

P(1∣score)=e1/(e3+e1+e-3)=0.12

P(-3∣score)=e-3/(e3+e1+e-3)=0

import numpy as np

def softmax(x):

exps=np.exp(x)

return exps/np.sum(exps)

调用

softmax([1,2,3])

输出结果

array([0.09003057, 0.24472847, 0.66524096])

如果我们使用较大的数字(或较大的负数)运行此函数,则会遇到问题,如下所示

调用

softmax([1000,2000,3000])

输出结果

array([nan, nan, nan])

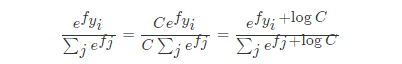

避免此问题的方法,在分子和分母中加入一个常数C,C常取值为logC=max(jfj)

最后得到的式子为

def stablesoftmax(x):

shiftx = x - np.max(x)

exps = np.exp(shiftx)

return exps / np.sum(exps)

stablesoftmax([1000, 2000, 3000])

输出

array([0., 0., 1.])

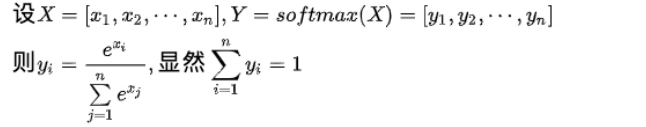

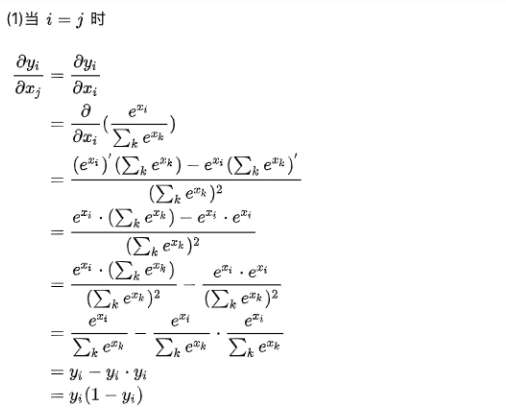

Softmax函数的导数输入多个x,输出多个y,那么对于任意y_i对x_j求导,i,j都属于K类别大小集合

原创文章 88获赞 1访问量 8093

关注

私信

展开阅读全文

原创文章 88获赞 1访问量 8093

关注

私信

展开阅读全文

作者:baihaisheng