Hadoop Namenode启动报错GC overhead limit exceeded

参考:

https://blog.csdn.net/rongyongfeikai2/article/details/82878578

文中所述,由于fsimage的inodes过多,造成启动时内存不够用所致。

需要用以下命令查看fsimage文件占用的内存大小:

./hdfs oiv -p XML -printToScreen -i ${fsimage文件路径} -o /tmp/a

cat /tmp/a | egrep "|" | wc -l | awk '{printf "Objects=%d : Suggested Xms=%0dm Xmx=%0dm\n", $1, (($1 / 1000000 )*1024), (($1 / 1000000 )*1024)}'

![]()

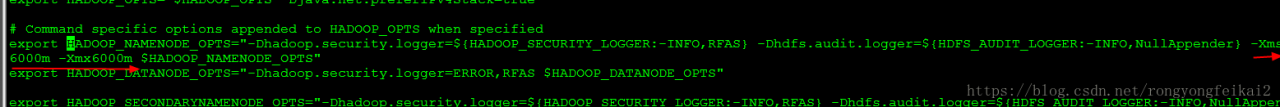

将hadoop-env.sh里的HADOOP_NAMENODE_OPTS里加上对于Xmx和Xms的配置:

我这里调整到了200g,配置完成后,重启Hadoop。

同时,从其他参考文档有提到,需要调整HADOOP_HEAPSIZE和HADOOP_NAMENODE_LIMIT_HEAPSIZE到适当的值。此例中,我尝试把HADOOP_HEAPSIZE从24576调整到36864(单位m),把HADOOP_NAMENODE_INIT_HEAPSIZE从40000调整到60000(单位m),但是启动仍然报错。

作者:nickyu888