Win10下安装并使用tensorflow-gpu1.8.0+python3.6全过程(显卡MX250+CUDA9.0+cudnn)

-----最近从github上找了一个代码跑,但是cpu训练的时间实在是太长,所以想用gpu训练一下,经过了一天的折腾终于可以用gpu进行训练了,嘿嘿~

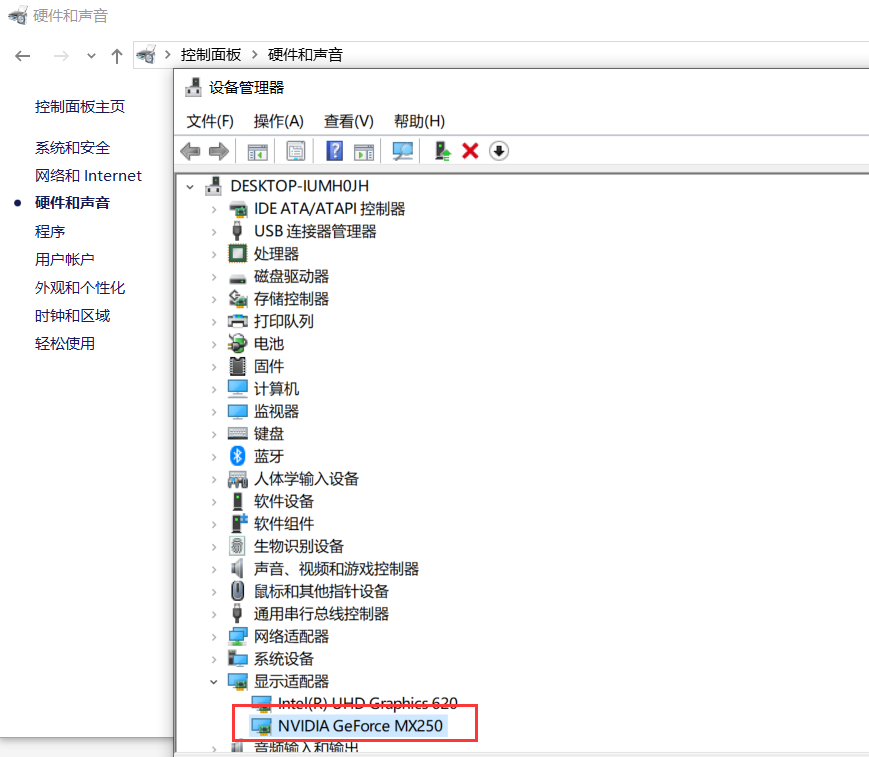

首先先看一下自己电脑的显卡信息:

可以看到我的显卡为MX250

然后进入NVIDIA控制面板->系统信息->组件 查看可以使用的cuda版本

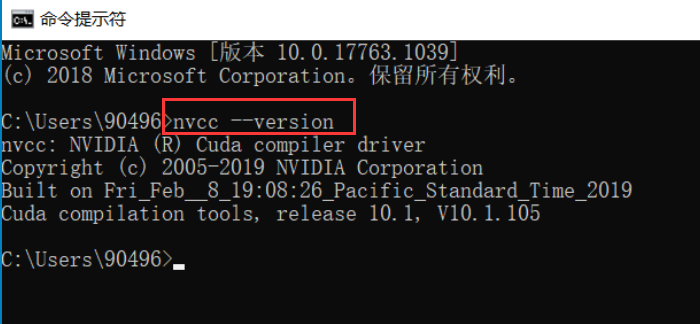

这里我先下载了cuda10.1的版本,不过后来我发现tensorflow-gpu 1.8.0仅支持cuda9.0的版本,所以之后我又重装了一遍cuda9.0,中间还经历了删除cuda10.0,两个版本的安装都是一样的。

进入官网:https://developer.nvidia.com/cuda-toolkit-archive找到和显卡信息相匹配的cuda(cuda是向下兼容的)

下载完成后按照默认的执行下去(当然也可以修改安装的路径)

在安装时如果电脑装有vs2017,那么这里建议取消VS Integration

然后一步步往下执行

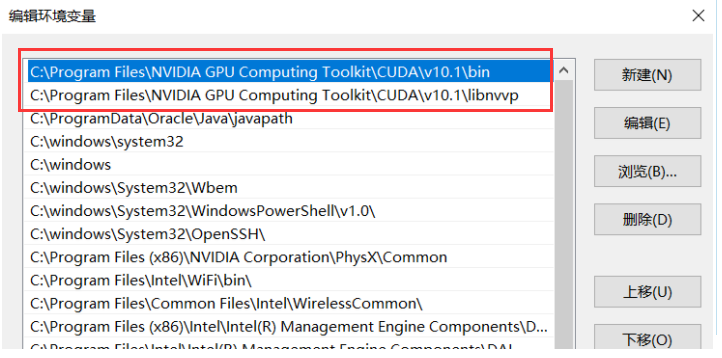

cuda的环境变量在安装时自动配置了,所以不需要我们操心

在这个网站先创建账户,再下载对应版本的cudnn

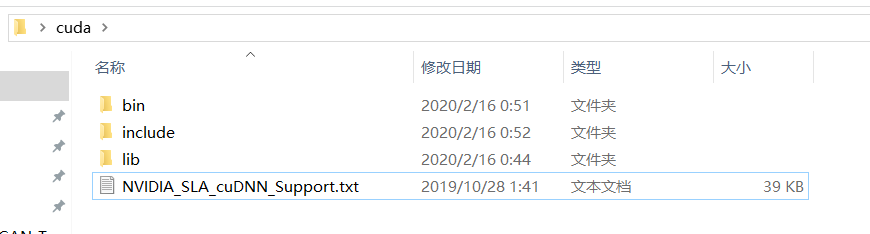

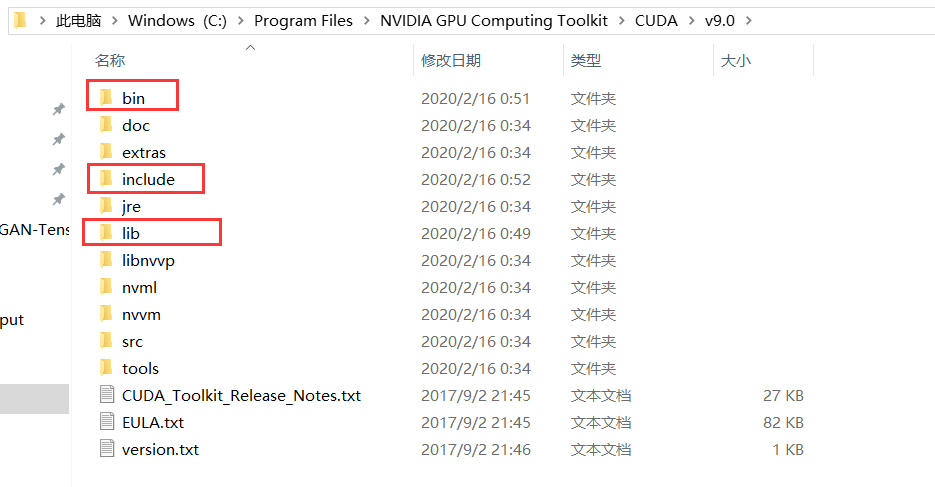

cudnn下载完成后进行解压,里面有三个文件夹

因为我安装的版本比较老了,现在最新的Anaconda已经装不了了,这里把我的Anaconda版本是Anaconda3-5.1.0-Windows-x86_64,使用的python版本是3.6

安装的时候记得把环境变量勾选上,这样就不用自己配置了

安装完成后创建一个名称为tensorflow的环境:

conda create --name tensorflow python=3.6

然后进入tensorflow环境中正式安装tensorflow-gpu

然后输入命令:

pip install -i https://pypi.tuna.tsinghua.edu.cn/simple tensorflow-gpu==1.8.0

等待安装完成即可

import tensorflow as tf

with tf.device('/cpu:0'):

a = tf.constant([1.0,2.0,3.0],shape=[3],name='a')

b = tf.constant([1.0,2.0,3.0],shape=[3],name='b')

with tf.device('/gpu:0'):

c = a+b

sess = tf.Session(config=tf.ConfigProto(allow_soft_placement=True,log_device_placement=True))

sess.run(tf.global_variables_initializer())

print(sess.run(c))

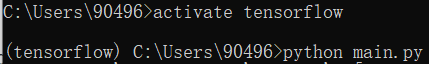

在刚才激活的tensorflow环境下进行运行:python + 文件名

![]()

结果如下:

![]()

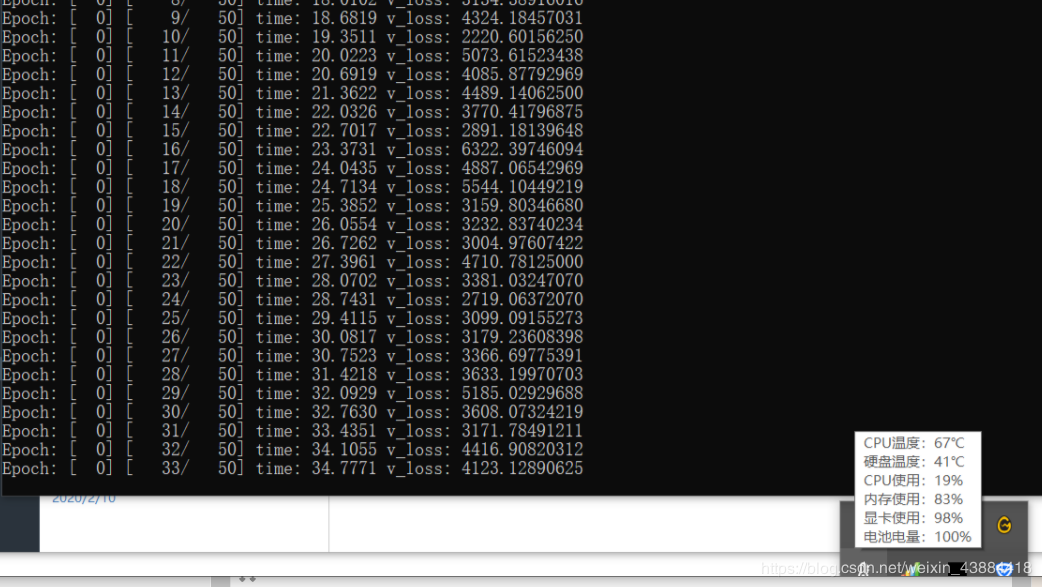

-----然后我运行了一下之前用cpu训练的代码,gpu训练的速度就是快,原先cpu要训练七八个小时的代码,gpu一个小时不到跑完了,还是爽啊,虽然我知道我的显卡很垃圾,,,,

可以看到显卡使用的情况了,哈哈哈~~

可以看到显卡使用的情况了,哈哈哈~~

作者:ice不加冰