UCBerkeley 深度强化学习-强化学习简介Lec4

课程内容

简介

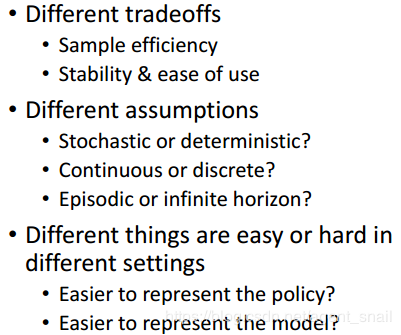

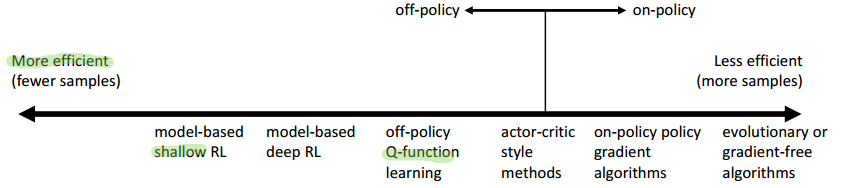

强化学习算法

几种强化学习方法的比较

简介

Part ♡1

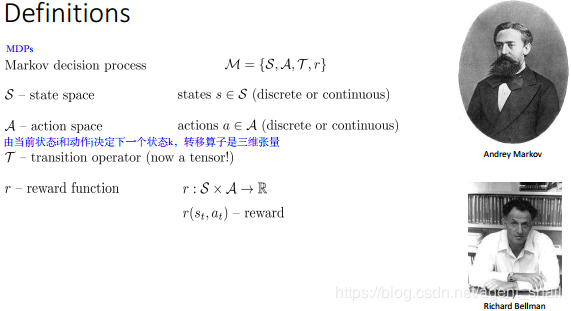

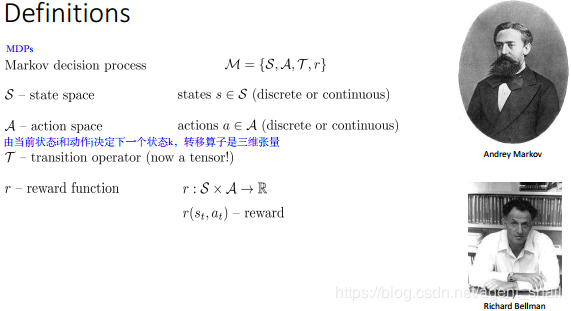

MDPS

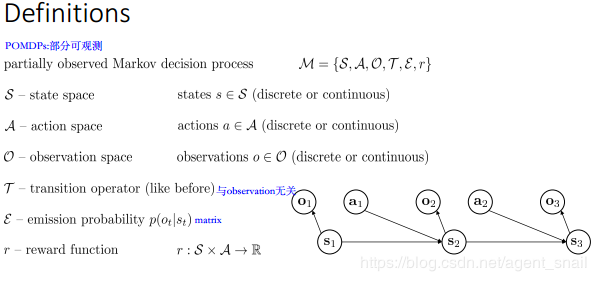

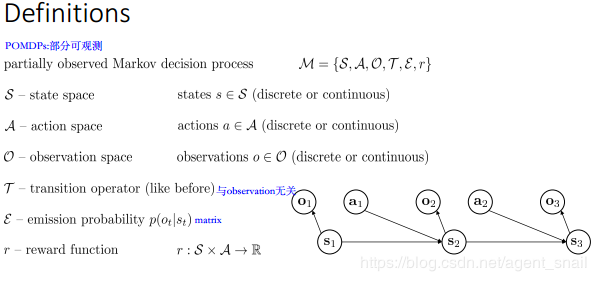

POMDPS(部分可观测)

POMDPS(部分可观测)

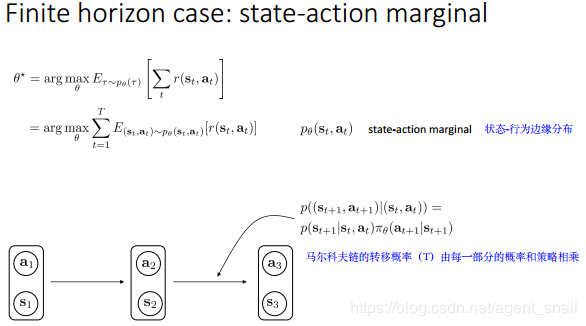

Part ♡2

Part ♡2

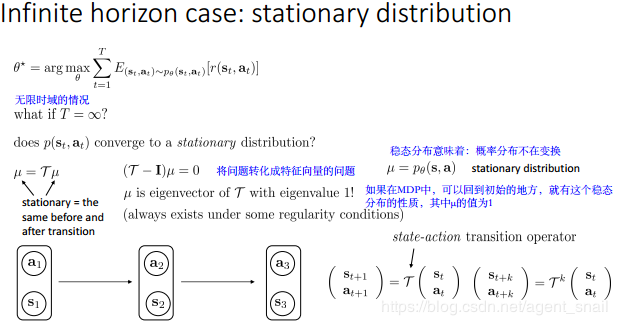

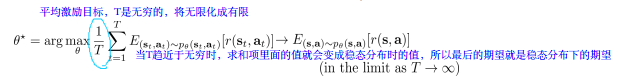

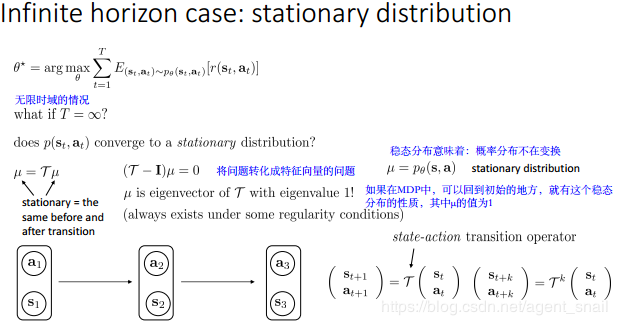

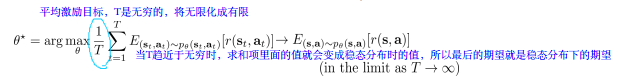

无限时间情况下

无限时间情况下

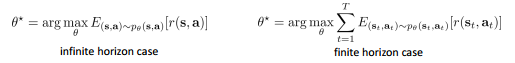

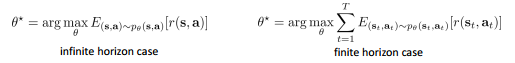

所以,在无限和有限的情况下的参数优化方式:

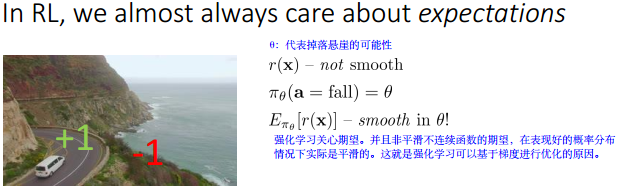

Part ♡3 强化学习关系期望!

Part ♡3 强化学习关系期望!

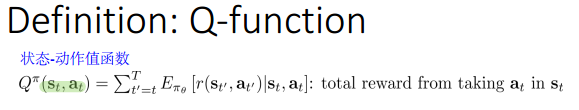

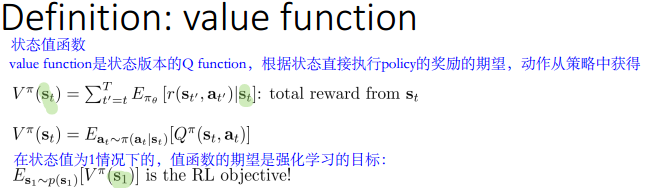

Value function

Value function

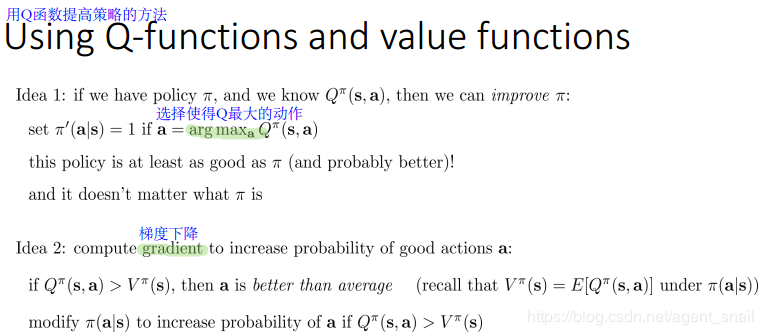

两种提高策略的思想

两种提高策略的思想

强化学习算法

强化学习算法

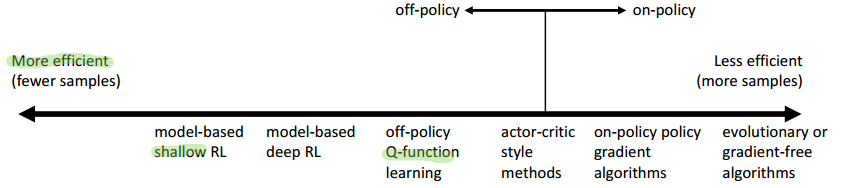

相比较而言,on policy训练过程中,采用的样本数量较大。样本效率会低。

执行时间(clock time)

执行时间(clock time)

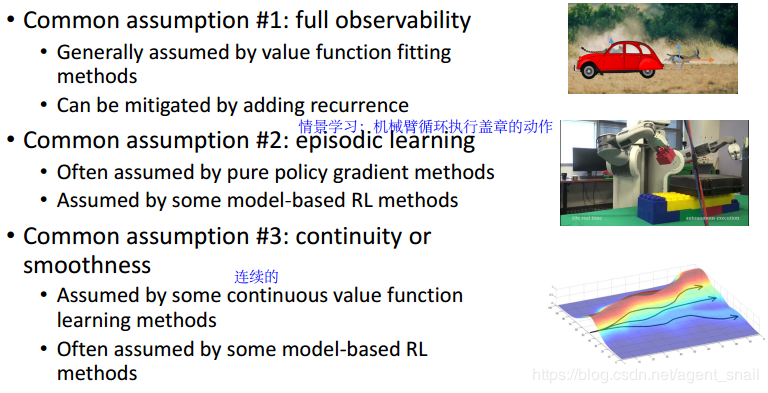

不是样本效率越高执行时间会越少! ☆假设

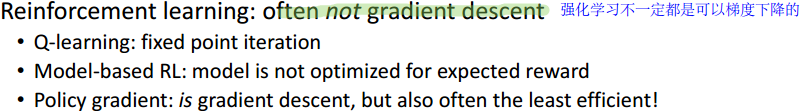

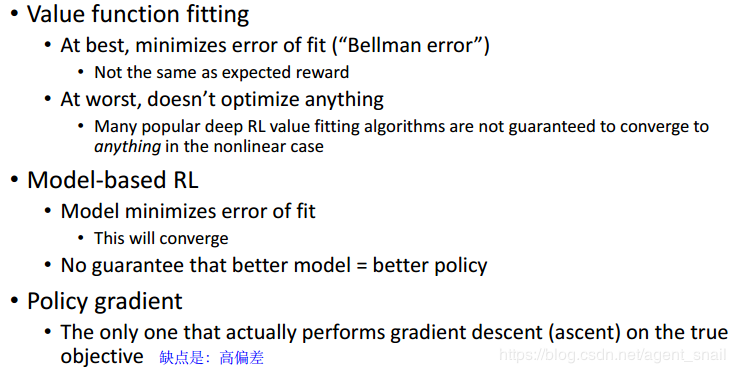

是否可以收敛?收敛的形式。

资源参考

资源参考

作者:pycolar

POMDPS(部分可观测)

POMDPS(部分可观测) Part ♡2

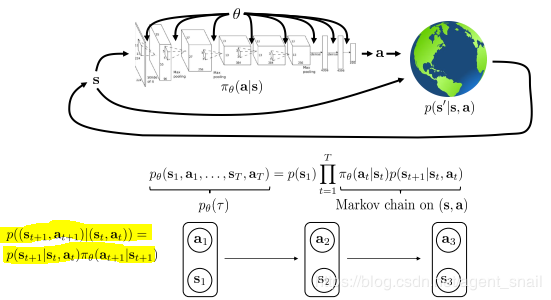

Part ♡2

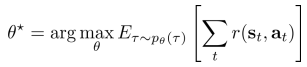

其中θ是策π略的参数,强化学习为了使得在当前状态st和当前选择的行为at的情况下的条件概率最大,则需要使得策略π最大,那么需要找到使得π最大的θ。

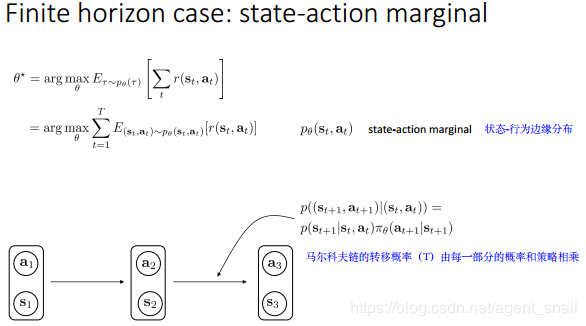

无限时间情况下

无限时间情况下

所以,在无限和有限的情况下的参数优化方式:

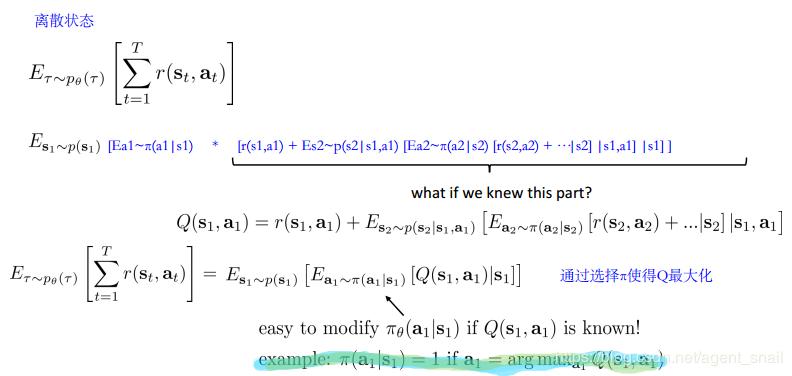

Part ♡3 强化学习关系期望!

Part ♡3 强化学习关系期望!

奖励函数r(x)是非平滑的,在策略π下的奖励函数的期望是平滑的!这就是可以进行梯度下降优化的原因!

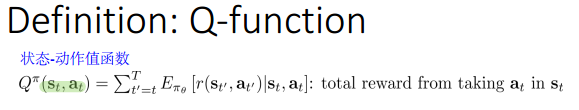

Value function

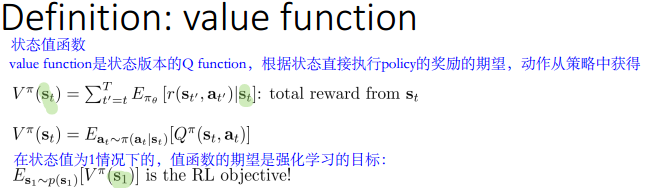

Value function 两种提高策略的思想

两种提高策略的思想 强化学习算法

强化学习算法

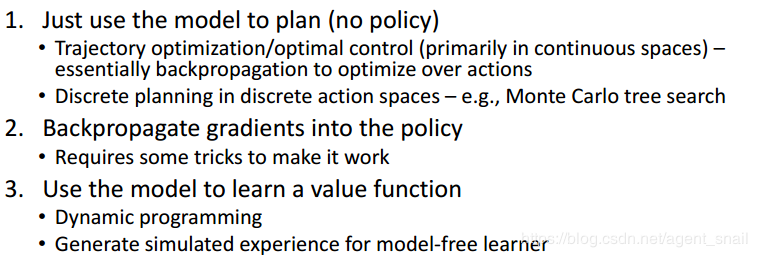

目标函数:

直接对上面的目标函数进行微分。

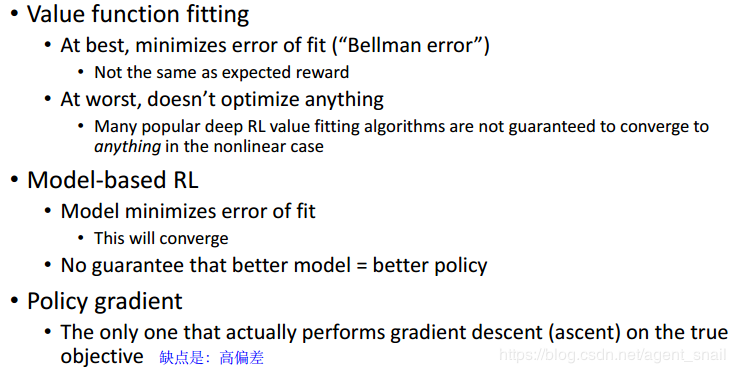

♧Value-Based在策略π没有明确给出的情况下,估计最优策略的Q或者value function,间接得到优化的policy。

♧Actor-Critic估计当前策略的Q或者value function,对Q或者value function做梯度下降。

♧Model-Based

相比较而言,on policy训练过程中,采用的样本数量较大。样本效率会低。

执行时间(clock time)

执行时间(clock time)不是样本效率越高执行时间会越少! ☆假设

是否可以收敛?收敛的形式。

资源参考

资源参考

课程官网:http://rail.eecs.berkeley.edu/deeprlcourse/

观看全部中英双语课程:https://ai.yanxishe.com/page/groupDetail/30?from=bilibili

伯克利大学 CS 294-112 《深度强化学习》为官方开源最新版本,由伯克利大学该门课程授课讲师 Sergey Levine 授权 AI 研习社翻译。添加字幕君微信:leiphonefansub 拉你入学习小组。更多经典课程在 ai.yanxishe.com

感谢字幕组的翻译!

作者:pycolar

相关文章

Iris

2021-08-03

Laraine

2020-04-28

Adelaide

2020-03-28

Kande

2023-05-13

Ula

2023-05-13

Jacinda

2023-05-13

Winona

2023-05-13

Fawn

2023-05-13

Echo

2023-05-13

Maha

2023-05-13

Kande

2023-05-15

Viridis

2023-05-17

Pandora

2023-07-07

Tallulah

2023-07-17

Janna

2023-07-20

Ophelia

2023-07-20

Natalia

2023-07-20

Irma

2023-07-20