Pytorch学习笔记——过拟合、欠拟合及其解决方案

验证数据集:测试集不可用于模型参数的调试,所以需要从训练数据集中分离出一部分数据作为验证数据集用来调参

1.2 K折交叉验证目前来说深度学习研究的普遍情况是数据量不够庞大,而我们要把模型数据分成训练集、验证集,这样就会导致训练数据更加少,K折交叉验证可以解决这个问题。算法思想大概是,将训练数据集均分成K个不同子集,第 i 次选取 K[ i ] 作为验证集,其余的 K-1 个数据作为训练集,这样我们就有了K组数据,最后将K次训练误差和验证误差取平均得到模型的训练误差和验证误差

2、过拟合和欠拟合 2.1 概念过拟合:训练集上的误差小于测试集上的误差

欠拟合:模型无法得到较低的训练误差

影响过拟合和欠拟合的两个因素:模型复杂度和训练数据集大小

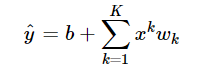

我们在深度学习模型中是需要寻找一个函数来拟合y,如下所示

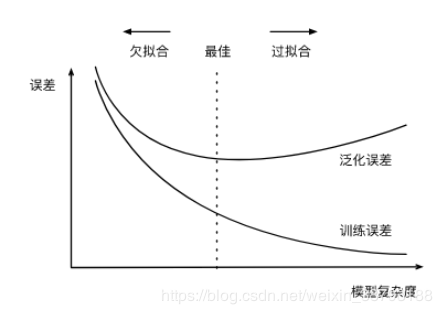

Wk是模型的权重,b是偏差,这里意味着K越大,函数模型越复杂,而在训练集固定的情况下,模型复杂度和误差之间有如下关系

也就是说,模型过于简单容易导致欠拟合(不能很好地表达训练数据),模型过于复杂容易导致过拟合(对训练数据表达得过好)

训练数据集中样本数过少容易导致过拟合,所以我们要根据训练集的大小合理地构建我们的深度学习模型网络

2.3 多项式函数拟合实验%matplotlib inline

import torch

import numpy as np

import sys

sys.path.append("/home/kesci/input")

import d2lzh1981 as d2l

初始化模型参数

# 预设三元函数参数

n_train, n_test, true_w, true_b = 100, 100, [1.2, -3.4, 5.6], 5

# 随机生成特征值

features = torch.randn((n_train + n_test, 1))

# torch.cat 拼接函数

# torch.pow幂指数函数

poly_features = torch.cat((features, torch.pow(features, 2), torch.pow(features, 3)), 1)

# 计算真实标签

labels = (true_w[0] * poly_features[:, 0] + true_w[1] * poly_features[:, 1]

+ true_w[2] * poly_features[:, 2] + true_b)

# torch.tensor 数据转换成tensor类型

# np.random.normal 随机生成正态分布噪声

# 因为现实中输出与输入不是标准的线性关系

labels += torch.tensor(np.random.normal(0, 0.01, size=labels.size()), dtype=torch.float)

# features[:2], poly_features[:2], labels[:2]

定义、训练和测试模型

# 定义一个画图函数

# d2l库

def semilogy(x_vals, y_vals, x_label, y_label, x2_vals=None, y2_vals=None,

legend=None, figsize=(3.5, 2.5)):

# d2l.set_figsize(figsize)

d2l.plt.xlabel(x_label)

d2l.plt.ylabel(y_label)

# 画第一条线

d2l.plt.semilogy(x_vals, y_vals)

# 若x2_vals和y2_vals同时存在,画第二条线,修改为虚线

if x2_vals and y2_vals:

d2l.plt.semilogy(x2_vals, y2_vals, linestyle=':')

d2l.plt.legend(legend)

# python中的赋值方法,设置迭代次数和损失函数

# num_epochs = 100

# loss = torch.nn.MSELoss()

num_epochs, loss = 100, torch.nn.MSELoss()

def fit_and_plot(train_features, test_features, train_labels, test_labels):

# 初始化网络模型

net = torch.nn.Linear(train_features.shape[-1], 1)

# 通过Linear文档可知,pytorch已经将参数初始化了,所以我们这里就不手动初始化了

# 设置批量大小

batch_size = min(10, train_labels.shape[0])

dataset = torch.utils.data.TensorDataset(train_features, train_labels) # 设置数据集

train_iter = torch.utils.data.DataLoader(dataset, batch_size, shuffle=True) # 设置获取数据方式

optimizer = torch.optim.SGD(net.parameters(), lr=0.01) # 设置优化函数,使用的是随机梯度下降优化

train_ls, test_ls = [], []

for _ in range(num_epochs):

for X, y in train_iter: # 取一个批量的数据

l = loss(net(X), y.view(-1, 1)) # 输入到网络中计算输出,并和标签比较求得损失函数

optimizer.zero_grad() # 梯度清零,防止梯度累加干扰优化

l.backward() # 求梯度

optimizer.step() # 迭代优化函数,进行参数优化

train_labels = train_labels.view(-1, 1)

test_labels = test_labels.view(-1, 1)

train_ls.append(loss(net(train_features), train_labels).item()) # 将训练损失保存到train_ls中

test_ls.append(loss(net(test_features), test_labels).item()) # 将测试损失保存到test_ls中

print('final epoch: train loss', train_ls[-1], 'test loss', test_ls[-1])

semilogy(range(1, num_epochs + 1), train_ls, 'epochs', 'loss',

range(1, num_epochs + 1), test_ls, ['train', 'test'])

print('weight:', net.weight.data,

'\nbias:', net.bias.data)

# 画图比较

# 拟合较好模型

fit_and_plot(poly_features[:n_train, :], poly_features[n_train:, :], labels[:n_train], labels[n_train:])

# 欠拟合

fit_and_plot(features[:n_train, :], features[n_train:, :], labels[:n_train], labels[n_train:])

# 过拟合

fit_and_plot(poly_features[0:2, :], poly_features[n_train:, :], labels[0:2], labels[n_train:])

思考:backward()和forward()函数的原理

3、过拟合解决方法 3.1 权重衰减等价于L2范数正则化,通过为模型损失函数增加惩罚项使得模型参数值变小,可以用于解决过拟合

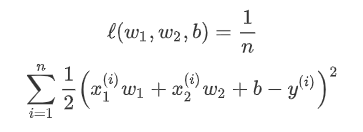

3.2 L2范数正则化L2范数正则化简单来说就是缩小模型中每一项的大小来达到解决过拟合的作用,以线性回归模型中的均方误差损失函数为例

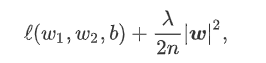

引入L2范数正则化后损失函数如下

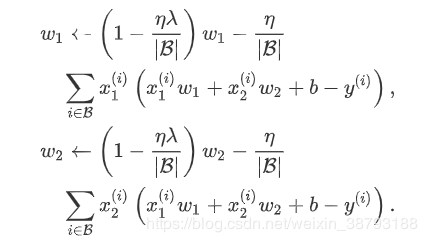

权重W的迭代更新如下

可以看到W的值随λ的增大而减小

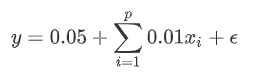

假定线性模型函数如下

引入过拟合我们可以通过控制数据集的大小,以及多维模型的维度,使得模型维度远大于数据集大小

%matplotlib inline

import torch

import torch.nn as nn

import numpy as np

import sys

sys.path.append("/home/kesci/input")

import d2lzh1981 as d2l

# 设置训练集大小为20,测试集为100,权重数量为200

# 这里num_inputs等于权重数量等于模型特征数量

n_train, n_test, num_inputs = 20, 100, 200

# 设置权重和偏差

# w全为0.01,b为0.05

# 这里的矩阵计算涉及到广播机制

true_w, true_b = torch.ones(num_inputs, 1) * 0.01, 0.05

# 为数据增加噪声

features = torch.randn((n_train + n_test, num_inputs))

labels = torch.matmul(features, true_w) + true_b

labels += torch.tensor(np.random.normal(0, 0.01, size=labels.size()), dtype=torch.float)

train_features, test_features = features[:n_train, :], features[n_train:, :]

train_labels, test_labels = labels[:n_train], labels[n_train:]

# 定义参数初始化函数,初始化模型参数并且附上梯度

def init_params():

w = torch.randn((num_inputs, 1), requires_grad=True)

b = torch.zeros(1, requires_grad=True)

return [w, b]

# 定义L2范数惩罚项

def l2_penalty(w):

return (w**2).sum() / 2

定义训练和测试

batch_size, num_epochs, lr = 1, 100, 0.003

# 线性回归模型 均方误差损失函数

net, loss = d2l.linreg, d2l.squared_loss

dataset = torch.utils.data.TensorDataset(train_features, train_labels)

# pytorch函数,数据生成器

train_iter = torch.utils.data.DataLoader(dataset, batch_size, shuffle=True)

# 画图函数

def fit_and_plot(lambd):

w, b = init_params()

train_ls, test_ls = [], []

for _ in range(num_epochs):

for X, y in train_iter:

# 添加了L2范数惩罚项

l = loss(net(X, w, b), y) + lambd * l2_penalty(w)

l = l.sum()

if w.grad is not None:

w.grad.data.zero_()

b.grad.data.zero_()

l.backward()

d2l.sgd([w, b], lr, batch_size)

train_ls.append(loss(net(train_features, w, b), train_labels).mean().item())

test_ls.append(loss(net(test_features, w, b), test_labels).mean().item())

d2l.semilogy(range(1, num_epochs + 1), train_ls, 'epochs', 'loss',

range(1, num_epochs + 1), test_ls, ['train', 'test'])

print('L2 norm of w:', w.norm().item())

对比过拟合和权重衰减

# 过拟合

fit_and_plot(lambd=0)

# 权重衰减

fit_and_plot(lambd=3)

简洁实现

def fit_and_plot_pytorch(wd):

# 对权重参数衰减。权重名称一般是以weight结尾

# 初始化模型参数

# net ,输入,输出

net = nn.Linear(num_inputs, 1)

nn.init.normal_(net.weight, mean=0, std=1)

nn.init.normal_(net.bias, mean=0, std=1)

# 定义优化器

optimizer_w = torch.optim.SGD(params=[net.weight], lr=lr, weight_decay=wd) # 对权重参数衰减

optimizer_b = torch.optim.SGD(params=[net.bias], lr=lr) # 不对偏差参数衰减

# 列表装训练误差和测试误差

train_ls, test_ls = [], []

# python中的缺省参数_

for _ in range(num_epochs):

for X, y in train_iter:

l = loss(net(X), y).mean()

optimizer_w.zero_grad()

optimizer_b.zero_grad()

l.backward()

# 对两个optimizer实例分别调用step函数,从而分别更新权重和偏差

optimizer_w.step()

optimizer_b.step()

# 每次迭代记录平均误差

train_ls.append(loss(net(train_features), train_labels).mean().item())

test_ls.append(loss(net(test_features), test_labels).mean().item())

# 画图对比训练误差和测试误差

d2l.semilogy(range(1, num_epochs + 1), train_ls, 'epochs', 'loss',

range(1, num_epochs + 1), test_ls, ['train', 'test'])

print('L2 norm of w:', net.weight.data.norm().item())

# 过拟合

fit_and_plot_pytorch(0)

# 权重衰减

fit_and_plot_pytorch(3)

B、丢弃法

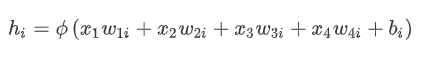

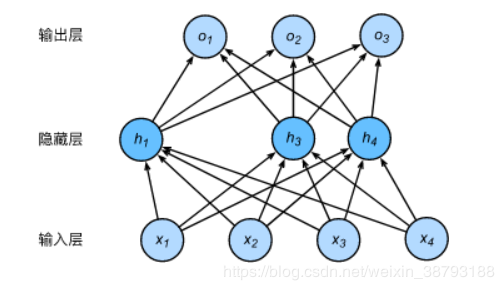

原理是根据概率p丢弃模型中的隐藏层,剩下的隐藏层除以1-p做拉伸,举例一个输入个数为4,隐藏单元为5,输出个数为3的单隐层感知机如下

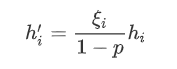

其中Φ为激活函数,x为特征值,w为权重参数,b为偏差。当使用丢弃法,且概率为p,hi会有p的概率被清零,1-p的概率除以1-p做拉伸,hi’ 为新的隐藏单元,如下

根据概率论中数学期望的性质可知

丢弃法不改变输入的期望,在训练过程中隐藏层中hi随机清零,输出层的计算不过度依赖任何一个神经元,但是在模型测试的时候不用丢弃法

%matplotlib inline

import torch

import torch.nn as nn

import numpy as np

import sys

sys.path.append("/home/kesci/input")

import d2lzh1981 as d2l

#定义drop_prob概率丢弃

def dropout(X, drop_prob):

X = X.float()

assert 0 <= drop_prob <= 1

keep_prob = 1 - drop_prob

# 这种情况下把全部元素都丢弃

if keep_prob == 0:

return torch.zeros_like(X)

mask = (torch.rand(X.shape) < keep_prob).float()

return mask * X / keep_prob

# 生成数据,验证

X = torch.arange(16).view(2, 8)

dropout(X, 0)

dropout(X, 0.5)

定义网络结构

drop_prob1, drop_prob2 = 0.2, 0.5

def net(X, is_training=True):

X = X.view(-1, num_inputs)

H1 = (torch.matmul(X, W1) + b1).relu()

if is_training: # 只在训练模型时使用丢弃法

H1 = dropout(H1, drop_prob1) # 在第一层全连接后添加丢弃层

H2 = (torch.matmul(H1, W2) + b2).relu()

if is_training:

H2 = dropout(H2, drop_prob2) # 在第二层全连接后添加丢弃层

return torch.matmul(H2, W3) + b3

def evaluate_accuracy(data_iter, net):

acc_sum, n = 0.0, 0

for X, y in data_iter:

if isinstance(net, torch.nn.Module):

net.eval() # 评估模式, 这会关闭dropout

acc_sum += (net(X).argmax(dim=1) == y).float().sum().item()

net.train() # 改回训练模式

else: # 自定义的模型

if('is_training' in net.__code__.co_varnames): # 如果有is_training这个参数

# 将is_training设置成False

acc_sum += (net(X, is_training=False).argmax(dim=1) == y).float().sum().item()

else:

acc_sum += (net(X).argmax(dim=1) == y).float().sum().item()

n += y.shape[0]

return acc_sum / n

训练

num_epochs, lr, batch_size = 5, 100.0, 256 # 这里的学习率设置的很大,原因与之前相同。

loss = torch.nn.CrossEntropyLoss()

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size, root='/home/kesci/input/FashionMNIST2065')

d2l.train_ch3(

net,

train_iter,

test_iter,

loss,

num_epochs,

batch_size,

params,

lr)

简洁实现

# 定义网络参数

net = nn.Sequential(

d2l.FlattenLayer(),

nn.Linear(num_inputs, num_hiddens1),

nn.ReLU(),

nn.Dropout(drop_prob1),

nn.Linear(num_hiddens1, num_hiddens2),

nn.ReLU(),

nn.Dropout(drop_prob2),

nn.Linear(num_hiddens2, 10)

)

for param in net.parameters():

nn.init.normal_(param, mean=0, std=0.01)

optimizer = torch.optim.SGD(net.parameters(), lr=0.5)

d2l.train_ch3(net, train_iter, test_iter, loss, num_epochs, batch_size, None, None, optimizer)

笔记内容摘录自:动手学深度学习Pytorch版

作者:DanzerWoo