pytorch损失反向传播后梯度为none的问题

错误代码:输出grad为none

a = torch.ones((2, 2), requires_grad=True).to(device)

b = a.sum()

b.backward()

print(a.grad)

由于.to(device)是一次操作,此时的a已经不是叶子节点了

修改后的代码为:

a = torch.ones((2, 2), requires_grad=True)

c = a.to(device)

b = c.sum()

b.backward()

print(a.grad)

类似错误:

self.miu = torch.nn.Parameter(torch.ones(self.dimensional)) * 0.01

应该为

self.miu = torch.nn.Parameter(torch.ones(self.dimensional) * 0.01)

补充:pytorch梯度返回none的bug

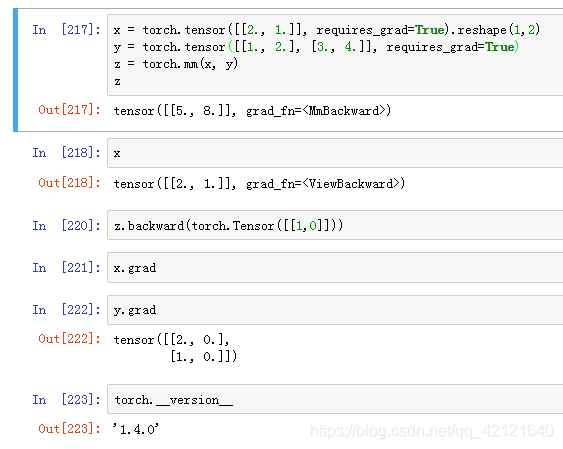

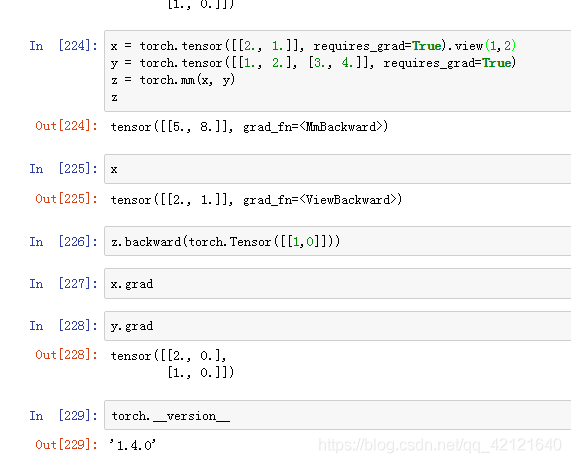

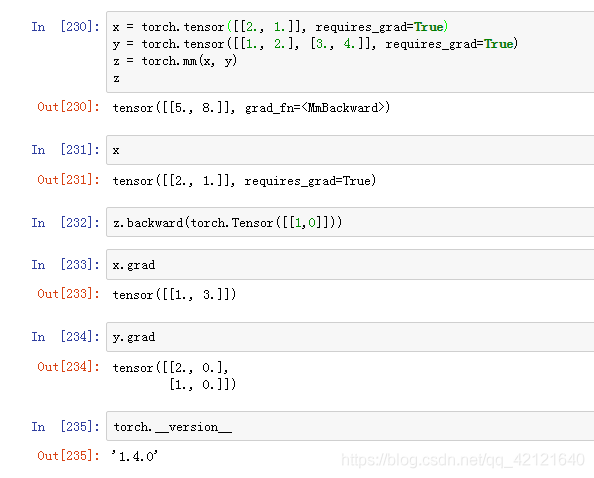

pytorch1.4.0如果使用了view方法,reshape方法tensor即使设置了requires_grad,反向传播之后, x返回没有grad梯度,为none

不知道其他版本有无此bug

补充:PyTorch中梯度反向传播的注意点

在一个迭代循环中optimizer.zero_grad()语句的位置比较随意,只要放在loss.backward()前面即可,它的作用是将梯度归零,否则会在每一个迭代中进行累加,

loss.backward()的作用是反向传播,计算梯度,optimizer.step()的功能是优化器自动完成参数的更新。

optimizer.zero_grad()

loss.backward()

optimizer.step()

以上为个人经验,希望能给大家一个参考,也希望大家多多支持软件开发网。